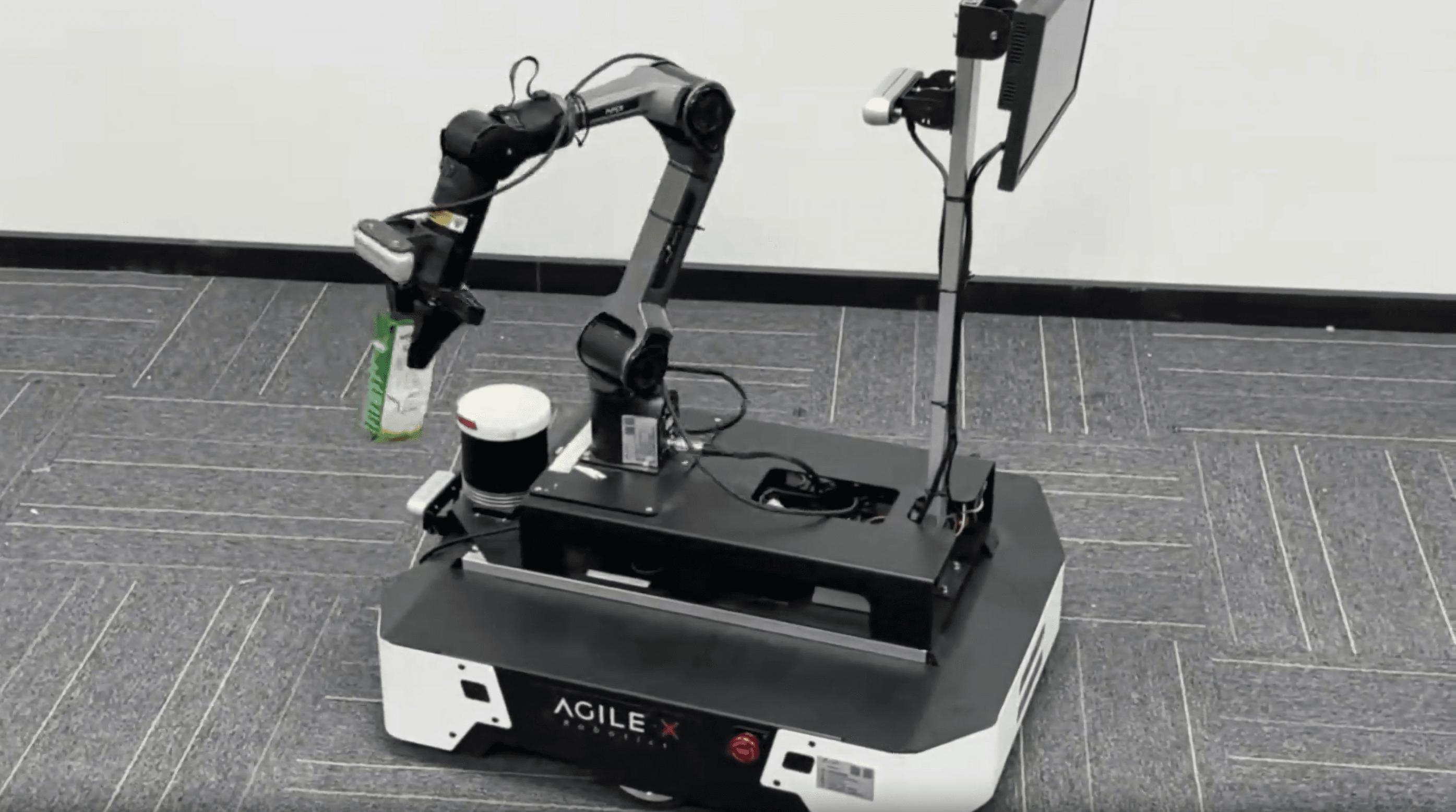

Visincept, в сътрудничество с Университета Цинхуа и Изследователския институт IDEA, представи SpatialPoint, пространствено осъзната рамка на визуално-езичен модел (VLM), която издига данните за дълбочина до основен вход заедно с RGB и текст.

Докато съществуващите VLM се представят добре при разпознаване на обекти, им липсва прецизно метрично 3D разбиране, което ограничава способността им да извеждат приложими координати за роботиката. SpatialPoint се справя с това чрез интегриране на структурирани данни за дълбочина директно в тръбопровода за разсъждение.

Изградена върху Qwen3-VL, рамката кодира RGB, дълбочина и текстови входове паралелно, което позволява цялостно 3D прогнозиране на точки в координатите на камерата.

Моделът използва двоен подход, съчетаващ специфично за дълбочината кодиране с подравняване на функции, заедно с двуетапна стратегия за обучение, която запазва възможностите за езиково зрение, като същевременно отключва геометрични разсъждения. При сравнителни тестове SpatialPoint постигна средна грешка при прогнозиране на разстоянието от 17,2 mm, повече от 30 пъти по-ниска от конвенционалните методи.

Екипът също пусна SpatialPoint-Data, набор от данни, съдържащ 2,6 милиона RGB-D двойки въпроси-отговори, обхващащи точки, които могат да се докосват, и въздушни точки. В експерименти с роботи в реалния свят моделът демонстрира интегрирани възможности в задачите за навигация, хващане и поставяне.

Източник: QbitAI

Source link

Like this:

Like Loading…

Нашия източник е Българо-Китайска Търговско-промишлена палaта